ELK 英文日志搜索

更新时间:2025-08-15 03:41:38

功能概述

本小节为用户呈现了英文日志从 Logstash 导入到 Elasticsearch,再通过 Kibana 进行搜索的完整的过程。

为了方便测试,此处选择了 logstash-http-input 插件输入日志数据,在实际应用中用户可以选择多种 Logstash Input 插件从各种数据源获取日志数据,比如文件、log4j、syslog、对象存储、Kafka 等。

另外,Logstash 默认将日志输出到 Elasticsearch 中,用户可以通过 output_es_content 配置项,对这个输出过程进行定制。用户还可以通过 output_conf_content 配置项,选择将日志输出到除了 Elasticsearch 之外的其他位置,比如对象存储。

操作步骤

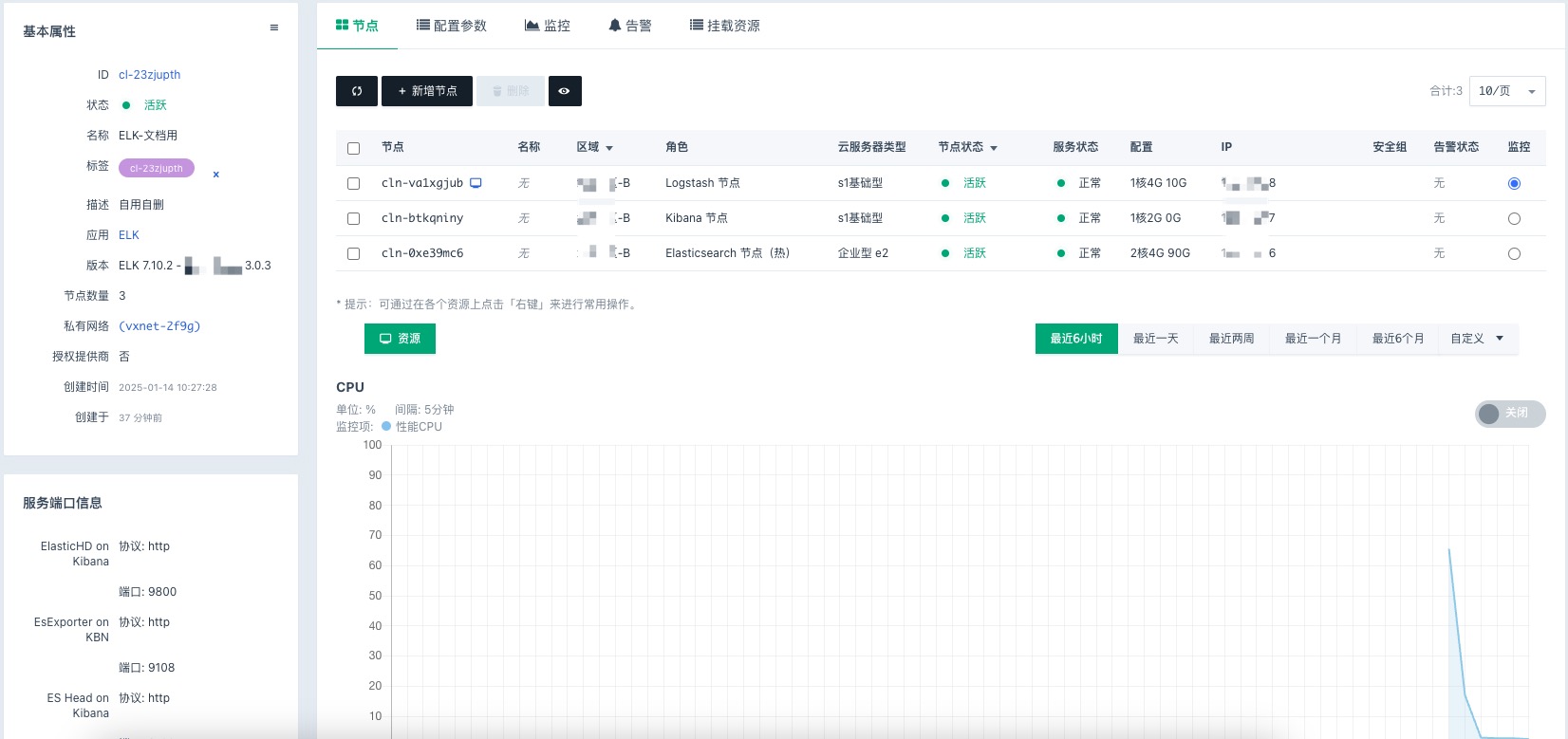

步骤一:获取 Logstash 节点信息

-

通过 Web 浏览器登录企业云平台的 Console。

-

在顶部菜单栏中选择产品与服务 > 大数据服务 > ELK 服务,进入 ELK 管理页面。

-

在 ELK 管理页面,点击目标集群 ID,进入集群详情页面。

-

在左侧服务端口信息区域,获取 Logstash 节点端口,默认为

9600。 -

在右侧节点标签页,获取 Logstash 节点的 IP 地址。

步骤二:发送数据

参照 Logstash 基本用法,执行如下命令将一条模拟日志发往 Logstash。

curl -d "[09-07 15:57:26]: call_es_api [:10105/_cluster/health] Exception [error: [Errno -5] No address associated with hostname], try to sleep 10 second." $LS_IP:9700步骤三:使用 Kibana 搜索

-

访问 Kibana 节点并配置 index pattern。详情参考如何访问 Kibana。

-

点击左侧的

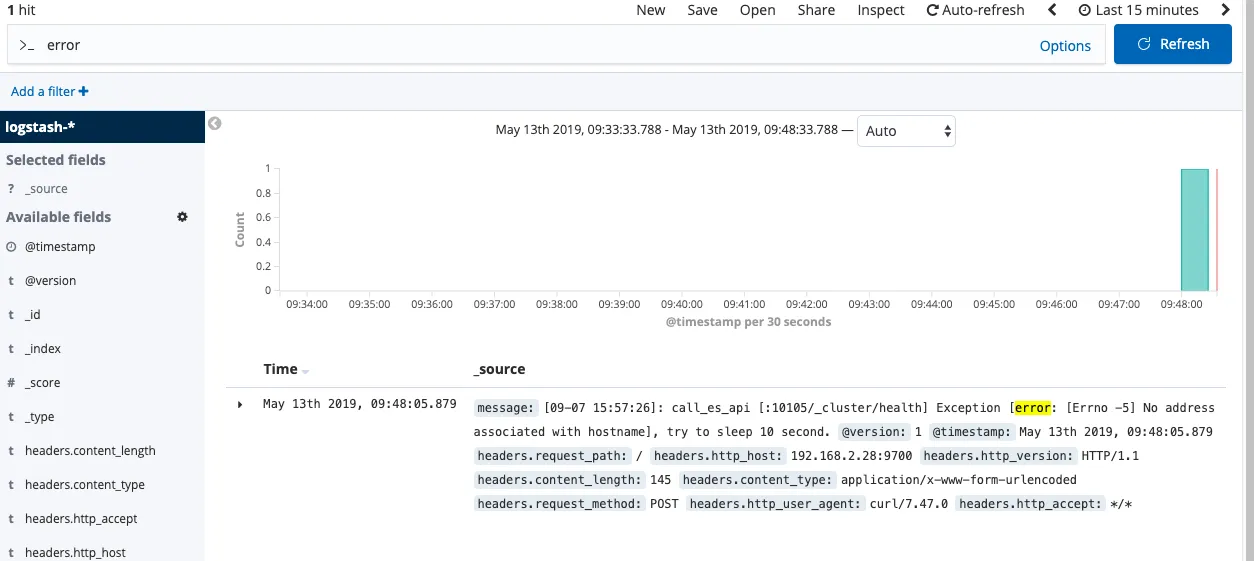

Discover菜单项,显示近期接收到的日志,在搜索栏中输入error,点击右侧的搜索按钮。 -

如图所示,

error被高亮显示,测试成功。